大数据系统数据采集产品的架构分析与数据处理服务解析

引言

随着数字化转型的深入,大数据已成为企业决策和业务创新的核心驱动力。一个高效、稳定的大数据系统,其根基在于数据采集与处理能力。本文将聚焦于大数据系统中数据采集产品的架构设计,并深入剖析其背后的数据处理服务,旨在为构建健壮的数据管道提供参考。

一、数据采集产品架构核心分析

数据采集作为大数据生命周期的起点,其架构设计直接决定了数据输入的效率、质量与可靠性。现代数据采集产品通常采用分层、模块化的架构,以适应多样化的数据源和复杂的业务场景。

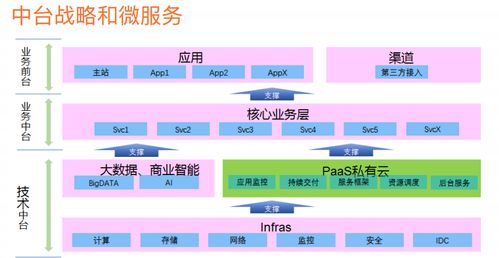

1. 架构分层概览

典型的架构可分为以下几层:

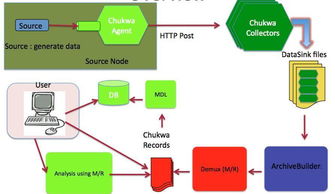

- 接入层:负责与各类数据源对接,如数据库日志(MySQL Binlog, Oracle Redo Log)、应用日志(Log4j, Nginx)、消息队列(Kafka, RocketMQ)、物联网传感器、API接口等。此层需要具备丰富的插件或适配器,以实现对不同协议的解析和数据格式的转换。

- 传输层:核心职责是数据的可靠传输。通常采用高吞吐、低延迟的消息队列(如Apache Kafka、Pulsar)作为缓冲,实现生产与消费的解耦,并保障在海量数据冲击下的系统稳定性。

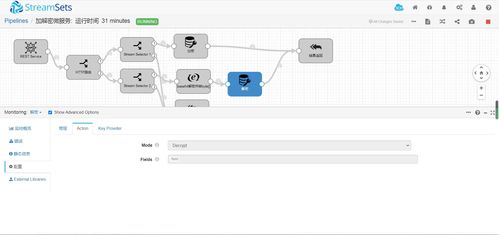

- 处理层:在数据进入存储之前进行初步的清洗、过滤、格式化、去重和简单聚合。这一层常借助流处理引擎(如Apache Flink、Spark Streaming)实现实时或准实时的处理逻辑。

- 管理层:提供统一的配置管理、监控告警、元数据管理和任务调度功能。通过可视化界面或API,实现对全链路采集任务的集中管控,确保系统的可观测性与可运维性。

2. 关键架构特性

- 可扩展性:采用分布式设计,支持水平扩展以应对数据量的增长。

- 容错性:具备完善的故障恢复机制,如断点续传、副本机制,确保数据不丢失。

- 低侵入性:对数据源系统的影响应最小化,通常通过读取日志或增量快照而非直接查询来实现。

- 标准化输出:将异构数据统一转换为标准格式(如Avro、Parquet、JSON),为下游处理奠定基础。

二、数据处理服务:从原始数据到业务价值

数据采集只是第一步,采集而来的原始数据必须经过系统的处理服务,才能转化为可用的信息与洞察。数据处理服务是架构中的“大脑”与“加工厂”。

1. 服务核心组件

- 批处理服务:针对历史存量或大批量数据的处理,典型框架如Apache Hadoop MapReduce、Apache Spark。它适用于对时效性要求不高但需要复杂计算和全量分析的场景,如日终报表生成、用户行为历史分析。

- 流处理服务:对连续不断的数据流进行实时处理,框架如Apache Flink、Apache Storm、Spark Streaming。它用于实时监控、实时推荐、欺诈检测等对延迟极其敏感的场景。现代架构中,流批一体(如Flink)正成为趋势,简化了技术栈。

- 数据集成与ETL/ELT服务:负责数据的抽取(Extract)、转换(Transform)与加载(Load)。随着云数据仓库的兴起,ELT模式(先加载到数据仓库再进行转换)愈发流行,利用云仓库的强大计算力进行转换。

- 数据质量与治理服务:在流程中嵌入数据质量校验(完整性、准确性、一致性)、元数据管理和数据血缘追踪,确保数据的可信度与合规性。

2. 处理流程与模式

数据处理服务通常遵循Lambda或Kappa架构。

- Lambda架构:同时维护批处理层和速度层(流处理层),最终在服务层合并结果。它兼顾了准确性与实时性,但维护两套系统复杂度高。

- Kappa架构:简化架构,所有数据都通过流处理系统处理,历史数据通过重播数据流来满足批处理需求。它更简洁,但对流处理引擎的要求极高。

3. 与采集架构的协同

数据处理服务紧密衔接数据采集产品。采集架构的传输层(如Kafka)是连接二者的关键桥梁,它既是采集端的出口,也是流处理服务的入口。处理层中的实时清洗逻辑也可以前移至采集产品的处理层,形成边缘计算,以减轻核心处理服务的压力。

三、与展望

一个优秀的大数据系统,其数据采集产品与数据处理服务必须进行一体化架构设计。采集架构的灵活性、稳定性和高性能,是保障数据“水源”充沛清澈的前提;而数据处理服务的实时性、准确性和智能化程度,则决定了数据价值提炼的深度与广度。随着云原生、AI驱动的数据管理以及DataOps理念的普及,数据采集与处理架构将向着更自动化、更智能、更融合的方向演进,实现从数据到业务洞见的无缝高效转化。

如若转载,请注明出处:http://www.scmgx.com/product/16.html

更新时间:2026-04-07 22:27:29