微服务架构体系下的数据处理服务 架构图、技术栈与服务体系剖析

在当今以数据为驱动的数字化时代,一个健壮、灵活且高效的微服务架构体系对于构建现代化应用至关重要。其中,数据处理服务作为该体系的核心支柱,承担着数据摄取、转换、存储、计算与分析的重任。本文将从架构图、技术栈与服务体系三个维度,深入剖析微服务架构下的数据处理服务。

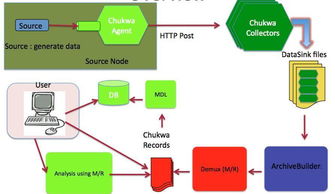

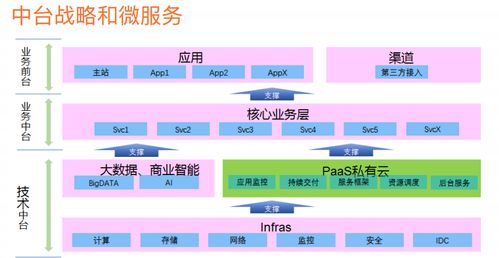

一、 整体架构图概览

一个典型的、包含数据处理服务的微服务架构体系通常呈现分层与模块化特点。其逻辑架构图可概括如下:

- 用户交互层: 包括Web、移动App等客户端,通过API网关与后端服务交互。

- API网关层: 作为统一入口,负责请求路由、认证、限流与聚合。

- 业务微服务层: 由多个独立部署、围绕业务能力组织的服务构成(如订单服务、用户服务)。这些服务会产生或消费业务数据。

- 数据处理服务层(核心):

- 数据摄取服务: 从业务服务、消息队列、日志文件、外部API等源头实时或批量收集数据。

- 流处理服务: 对实时数据流进行过滤、转换、聚合(如使用Apache Flink, Apache Kafka Streams)。

- 批处理服务: 对海量历史数据进行ETL(提取、转换、加载)、报表生成等(如使用Apache Spark)。

- 数据存储服务: 提供对各类数据库(关系型MySQL/PostgreSQL、NoSQL如MongoDB/Cassandra、时序数据库InfluxDB)、数据仓库(如Snowflake, BigQuery)和数据湖(基于HDFS或S3)的抽象访问与管理。

- 数据查询/API服务: 对外提供统一的数据查询接口或GraphQL端点,供内部服务或前端调用。

- 支撑服务层:

- 服务注册与发现: 如Consul, Nacos, Eureka。

- 配置中心: 如Spring Cloud Config, Apollo。

- 消息中间件: 如Kafka, RabbitMQ,用于服务间异步通信和数据管道。

- 监控与日志: 如Prometheus, Grafana, ELK Stack。

- 分布式追踪: 如SkyWalking, Jaeger。

- 基础设施层: 容器化平台(如Kubernetes)、云服务或物理服务器。

数据处理服务与业务服务通过消息队列或直接API调用松耦合连接,形成清晰的数据流边界。

二、 关键技术栈选型

构建数据处理服务,技术栈的选择需兼顾性能、一致性、可扩展性与开发运维效率。

- 数据流与消息: Apache Kafka 已成为实时数据管道的事实标准,用于高吞吐量的数据摄取与发布订阅。Pulsar 是另一个新兴选择。

- 流处理: Apache Flink 以其精确的状态管理和低延迟处理能力领先;Apache Kafka Streams 与Kafka生态集成度极高,轻量级;Spark Streaming 适合微批处理场景。

- 批处理: Apache Spark 凭借其内存计算和丰富的生态(SQL, MLlib)占据主导地位。

- 数据存储:

- 操作型数据: PostgreSQL, MySQL。

- 文档存储: MongoDB,用于半结构化数据。

- 缓存: Redis。

- 宽列存储: Cassandra, ScyllaDB,用于海量时序或高写入场景。

- 数据仓库/湖: Snowflake, Amazon Redshift, Google BigQuery(云原生数仓);Apache Hudi, Delta Lake, Apache Iceberg(数据湖表格式,构建于S3/HDFS之上)。

- 任务编排与调度: Apache Airflow 或 Dagster,用于管理复杂的批处理工作流。

- 服务框架与部署: Spring Cloud / Micronaut / Quarkus(Java),Go Micro,结合 Docker 与 Kubernetes 实现容器化部署与弹性伸缩。

- 可观测性: 使用 Prometheus 收集指标,Grafana 可视化,ELK 或 Loki 处理日志,Jaeger 进行分布式追踪。

三、 数据处理服务体系设计

数据处理并非单一服务,而是一个由多个专注单一职责的服务协同工作的体系。其服务体系设计遵循微服务核心原则:

- 服务边界与职责分离:

- 数据摄取服务: 专精于从多样源端可靠地拉取或接收数据,进行初步校验后投递至消息队列或数据湖。

- 数据转换/丰富化服务: 独立服务,消费原始数据,应用业务规则进行清洗、标准化、关联外部数据,输出高质量数据。

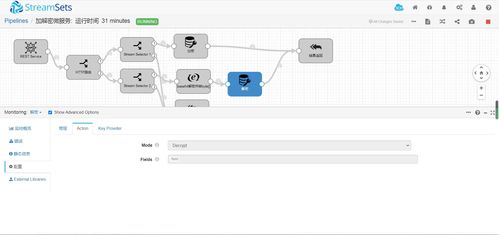

- 计算引擎服务: 封装Flink/Spark作业,作为可独立部署和扩缩容的服务,对外提供作业管理API。

- 数据查询服务: 对内/对外提供统一SQL或REST/GraphQL接口,隐藏底层存储的复杂性,实现数据安全与访问控制。

- 事件驱动与异步通信: 数据处理流程普遍采用事件驱动模式。业务服务将领域事件发布到Kafka,数据处理服务订阅这些事件并作出反应,实现了业务逻辑与数据逻辑的解耦,提升了系统整体的响应性和韧性。

- 数据一致性保证: 在分布式环境下,采用“最终一致性”模式。通过事件溯源(Event Sourcing)和变更数据捕获(CDC,如Debezium)技术,可靠地捕获业务数据变更并同步至数据分析侧。

- 可扩展性与弹性: 每个数据处理服务均可根据负载独立水平扩展。利用Kubernetes的HPA(水平Pod自动伸缩)和流处理框架的并行度调整,从容应对数据洪峰。

- 数据治理与质量: 将数据质量检查(如完整性、准确性校验)、元数据管理(如数据血缘)功能模块化为独立服务或集成在数据流水线中,确保数据的可信度。

- 安全与合规: 在API网关和数据查询服务层实施细粒度的认证授权(如OAuth2, JWT),对敏感数据在传输和静止时进行加密,审计关键数据访问操作。

###

在微服务架构中,将数据处理能力构建为一套松散耦合、职责清晰、事件驱动的服务体系,而非一个庞杂的单体,是成功的关键。通过合理规划架构、选型适配的技术栈并精心设计服务间的协作机制,数据处理服务能够成为企业灵活应对业务变化、深入挖掘数据价值的强大引擎,有力支撑起从实时决策到智能分析的各类应用场景。

如若转载,请注明出处:http://www.scmgx.com/product/9.html

更新时间:2026-04-07 03:58:57